Facebook Reality Labs показала революционный интерфейс для виртуальной реальности, основанный на электромиографии, который позволяет вводить информацию без клавиатуры и контроллеров. Система использует электрические сигналы, перемещающиеся от спинного мозга к руке.

Виртуальная реальность

Шлемы виртуальной реальности существуют уже давно и одной из главных проблем с самого появления были системы ввода информации. И если с навигацией еще как-то справлялись — наведением указателя поворотом головы или с помощью контроллеров, то с более сложными манипуляциями были проблемы, особенно с набором текста. Несколько лет назад в Google экспериментировали, например, с виртуальными молоточками, которыми били по гигантским виртуальным клавишам. Процесс отдаленно напомнил игру на ксилофоне. Последняя гарнитура Oculus Quest 2, например, может управляться жестами рук — медленно и непредсказуемо. Какого-то удобного решения не было.

Oculus Quest 2

Oculus Quest 2

Миниатюризация носимых гарнитур VR/AR в скором времени уменьшит их до размеров очков и они станут постоянно носимым аксессуаром, что исключает применение привычных контроллеров. Голосовое управление, которое применялось в Google Glass — тоже не выход. Мало того, что бубнящий себе под нос человек выглядит странно, речевая система ввода довольна медленна и имеет много ограничений. VR/AR-интерфейс должен быть социально приемлемым во всех отношениях — безопасным, приватным, ненавязчивым, простым в освоении, простым в использовании, удобным, носимым в течение всего дня, легким и надежным. Подобный интерфейс потребует полного переосмысления того, как взаимодействуют люди и компьютеры, и изменит наши отношения с цифровым миром так же, как и графический интерфейс.

Новое — старое забытое

Существует механизм, который люди носят на руке уже несколько столетий — наручные часы. Эту идею за основу и взяли исследователи из Facebook Reality Labs (FRL). Работа над интерфейсом началась еще шесть лет назад в бывшей лаборатории Oculus Research. Разработанный FRL наручный интерфейс Human-Computer Interaction (HCI) базируется на нескольких революционных технологиях. Это нейронный ввод, электромиография (ЭМГ), которая использует электрические сигналы, перемещающиеся от спинного мозга к руке, чтобы управлять функциями устройства на основе декодирования сигнала на запястье. Сигналы через запястье настолько ясны, что ЭМГ может обнаружить движение пальца всего на миллиметр. Ввод получается легким — таким же легким, как нажатие виртуальной кнопки. Мало того, ЭМГ детектирует даже намерение переместить палец.

Вторая технология — использование искусственного интеллекта, контекста и персонализации. Интерфейс адаптируется к потребностям пользователя, и понимает, какая информация требуется или какие действия вы хотите совершить в конкретных контекстах.

Прототип

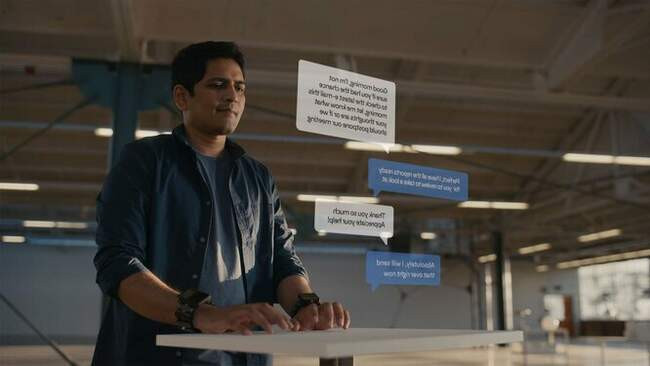

Одно дело написать, другое дело — увидеть. Прототип HCI от Facebook Reality Labs сейчас размерами напоминает первые дайв-компьютеры. На закрытой презентации на меня его работа произвела неизгладимое впечатление и дала довольно полное представление о том, что нас ждет в ближайшем будущем. В браслет встроены датчики для преобразования электрических двигательных нервных сигналов, которые проходят через запястье к руке, в четкие однобитовые команды, которые используются для управления функциями устройства. «То, что мы пытаемся сделать с нейронными интерфейсами — позволить управлять машиной напрямую, используя нервы вне мозга, которые оживляют мышцы вашей руки и пальцев», — говорит директор FRL по нейромоторным интерфейсам Томас Рирдон. Это не похоже на чтение мыслей. Когда вы хотите опубликовать несколько фотографий, мозг совершает довольно много операций по выбору нужных изображений, и только потом посылает информацию рукам и пальцам, какие действия для этого нужно совершить. Речь идет о декодировании этих сигналов на запястье — действий, которые вы уже решили выполнить, — и переводе их в цифровые команды для компьютера.

Сегодня ЭМГ обеспечивает лишь один или два бита управления, которые Томас Рирдон называет «щелчком», эквивалентом нажатия на кнопку. Это жесты, основанные на движении, такие как щипок и отпускание большого и указательного пальцев, которые легко выполнять, независимо от того, где находитесь или что делаете, во время ходьбы, разговора или даже держа руки в карманах. Щелчок пальцами всегда будет работать просто так, без необходимости активации, что делает его первым общим взаимодействием AR/VR.

Это первый шаг, ЭМГ в конечном итоге перейдет к более богатым элементам управления. В виртуальной реальности можно будет фактически касаться и перемещать объекты, что можно видеть на видео. Также можно будет управлять виртуальными объектами на расстоянии, что раньше проделывали только джедаи в «Звездных войнах». Мы сможем печатать на высокой скорости на столе или коленях — даже на более высокой, чем возможно сегодня с клавиатурой. Первоначальные исследования многообещающи — FRL добилась значительного прогресса, сократив время, необходимое для обучения пользовательских моделей клавиатуры, которые адаптируются к скорости и технике набора текста человека.

«Цель нейронных интерфейсов — разрушить долгую историю взаимодействия человека и компьютера и сделать так, чтобы люди имели больше контроля над машинами, чем они над нами», — объясняет Риардон. Традиционной QWERTY-клавиатуре более 150 лет. Представьте виртуальную клавиатуру, которая со временем учится и адаптируется к вашему уникальному стилю набора текста (опечатки и все остальное). Результатом будет практически встроенная в вас клавиатура, которая будет быстрее, чем любой механический интерфейс набора текста, причем она всегда будет под рукой.

Адаптивный интерфейс

«Лежащий в основе HCI искусственный интеллект имеет представление о том, что вы захотите сделать в будущем, — объясняет научный менеджер FRL Research Таня Йонкер. — Вы выходите на пробежку, и, основываясь на вашем прошлом поведении, система считает, что вы, скорее всего, захотите послушать свой беговой плейлист. Затем представляет эту опцию на дисплее: "Воспроизвести запущенный плейлист?» И вы сможете просто подтвердить или изменить предположение с помощью легкого движения пальцами. Что может сэкономить всего несколько секунд на каждое взаимодействие, но эти секунды складываются. И, что более важно, легкие жесты не будут отвлекать от хода мыслей или от движения.»

Представьте, например, сколько времени можно сэкономить, если не надо останавливать то, что делаете, чтобы выбрать и открыть нужное приложение, прежде чем взаимодействовать с цифровым миром? Чтобы очки AR действительно улучшали нашу жизнь и позволяли оставаться в настоящем моменте, нужен адаптивный интерфейс, который ненавязчиво выводит цифровую информацию на экран только тогда, когда она актуальна, а затем естественным образом прячет её.

Тактильность

Ещё одна нерешенная проблема — обратная тактильная связь. Когда об этом заговорили на презентации я подумал о вообще невероятном — что браслет HCI будет генерить электроимпульсы, имитирующие тактильные сигналы в нервных волокна на подушечках пальцев, и обманывать наш мозг. Но нет — пока это из области научной фантастики, пусть и недалекой. Но как сделать виртуальные объекты осязаемыми? Этим занимается гаптика — наука, которая изучает взаимодействия людей через тактильный контакт. «Мы эволюционировали, чтобы использовать тактильные сигналы для познания мира, — говорит научный директор FRL Research Шон Келлер. — Именно гаптика позволяет использовать инструменты и точный контроль. От хирурга, использующего скальпель, до концертного пианиста, чувствующего края клавиш — все зависит от гаптики. Наш браслет — только начало. Мы не можем воспроизвести все ощущения в виртуальном мире, которые можно почувствовать при взаимодействии с реальным объектом в реальном мире, но мы начинаем воспроизводить некоторые из них».

«Гаптика может передавать различные эмоции — мы называем это тактильными эмодзи, — добавляет научный руководитель FRL Research Николас Колоннес. — Если вы находитесь в правильном контексте, различные типы тактильной обратной связи могут соответствовать популярным смайликам. Это может стать новым игровым способом социального общения». Один из таких прототипов с обратной связью Bellowband, названный в честь восьми расположенных вокруг запястья пневматических сильфонов — упругой гофрированной оболочки. Воздух внутри сильфона используется для передачи давления и вибраций. Это ранний исследовательский прототип, помогающий определить типы тактильной обратной связи, достойные дальнейшего изучения. Другой прототип, Tasbi (Tactile and Squeeze Bracelet Interface), использует шесть вибротактильных приводов и другой механизм сжатия запястья.

Прототипы являются важным шагом на пути к возможному созданию тактильной обратной связи, которая кажется неотличимой от реальных объектов и действий. Биологическое явление, так называемая сенсорная подмена, на самом деле возможно: наш ум комбинируя визуальное, аудио и тактильные стимулы, дает виртуальным переживаниям новые измерения. Это ранняя, но весьма многообещающая технология.

Современные устройства позволяют нам общаться с людьми, находящимися далеко от нас, не стесняя временем и пространством, но слишком часто эти связи происходят за счет людей, физически находящихся рядом с нами, считают в Facebook Reality Labs. Мы говорим себе, что если бы у нас было больше силы воли, мы бы отложили смартфон и сосредоточились на разговоре с живыми людьми. Это ложный выбор. Наш мир одновременно цифровой и физический, и мы не должны жертвовать одним, чтобы по-настоящему принять другое.

Нужно создавать устройства, которые не будут заставлять выбирать между людьми и нашими устройствами. Устройства будущего позволят оставаться в мире, чтобы мы могли делать то, для чего мы и созданы как люди — общаться и сотрудничать.

Но для того, чтобы пришла следующая великая волна ориентированных на человека технологий, нужен сдвиг парадигмы, который действительно поместит людей в центр. Наши устройства должны адаптироваться к нам, а не наоборот. Это означает, что виртуальная реальность нуждается в своем собственном Дугласе Энгельбарте.